一、环境

机器学习在近几年来一直是特别火的分析主题风格,它是人工智能技术关键,也是推动电子计算机具备智能化的根本措施。它的主要每日任务有分类、聚类分析等,其实质全是在尝试使设备通过学习很多的专业知识,得到仿真人的策略开展预测分析或管理决策的工作能力,例如决策某一封电子邮件是否故意的。那样的新技术特性与网络安全自动化技术的发展趋向是一致的,大家必须一台24小時运行的设备来协助大家分辨好与坏并采用应急处置对策,因此机器学习在网络安全得到大展身手。可是通常处理一个问题很有可能便会造成新的问题,一个技术性可以被用于防御力,与此同时也很有可能被别人用来攻击。机器学习的运用在某类层面解放了网络安全防御者的与此同时,也给了攻击者一个新的突破口,与此相关的对抗攻击逐渐变成一个新的问题。

二、主要内容

文中第一详细介绍了机器学习、网络安全及对抗攻击这三个行业以及交叉式运用层面的基本知识,行为主体部份由六章构成:机器学习基本、机器学习在网络安全中的运用、对于机器学习的对抗攻击方式、对抗攻击分类、对抗攻击风险评价与对抗攻击的防御力方式,文章内容最终根据前述工作中完成了项目前期的汇总和将来研究内容的论述。

1、机器学习基本

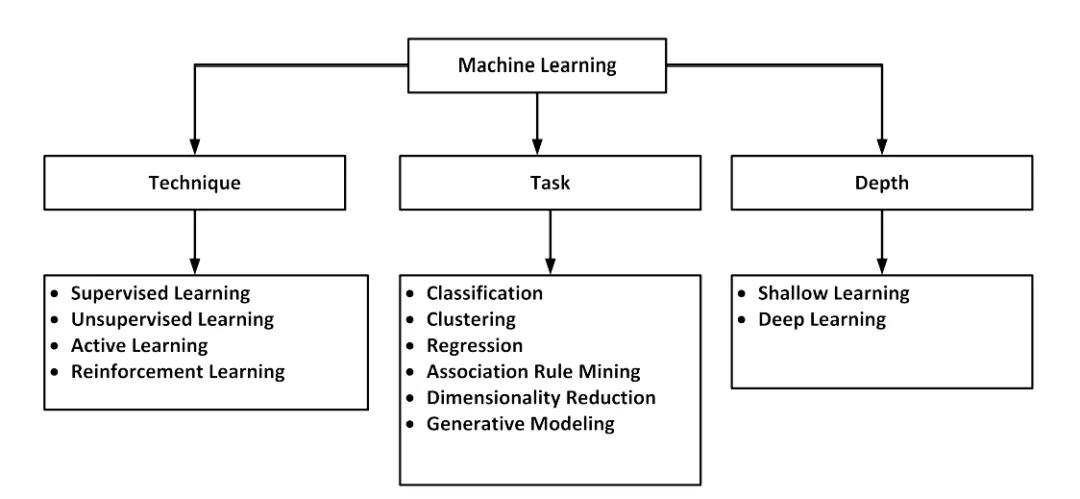

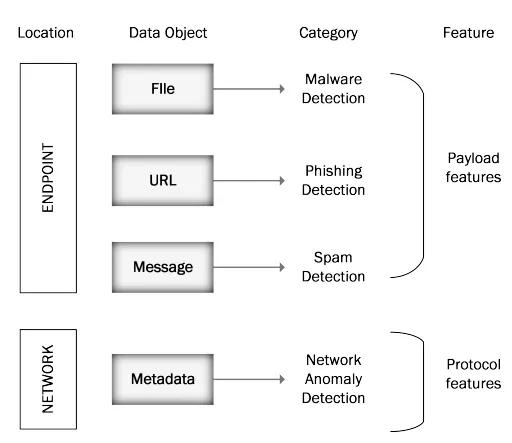

机器学习依据所需方式和可以用基本数据类型实行多种类型的每日任务[1]。文章内容依照三种规范对机器学习开展分类:学习技术、目标任务与学习培训深层(如下图一),并逐一详细介绍其特性。

在目标任务的一部分,文章内容将通用性的机器学习每日任务与网络安全结合在一起,并列举实际的优化算法事例。分类任务模型在网络安全中被用来检验已经知道种类的诈骗[2],并用以对不一样客户开展分类,如社交媒体垃圾短信发件人[3]。除此之外,它还用以将程序流程和文档分成恶意程序、间谍软件和勒索病毒三种种类;聚类分析每日任务则是利用较为工作流程来检验出现异常值[4];在网络安全中,应用回归分析从互联网数据中预测分析有关主要参数,随后将他们和基本主要参数开展较为[5],还被用以互联网中的异常检测、用户行为分析(如人机交互技术证实)和出现异常个人行为预测分析 [2],如银行信用卡诈骗买卖。这反映出现阶段机器学习在网络安全行业已获得了比较普遍的运用,假如发生攻击问题可能产生非常大不良影响,因而这种科学研究是十分必需且令人难忘的。

图一 机器学习分类[1]

2、机器学习在网络安全中的运用

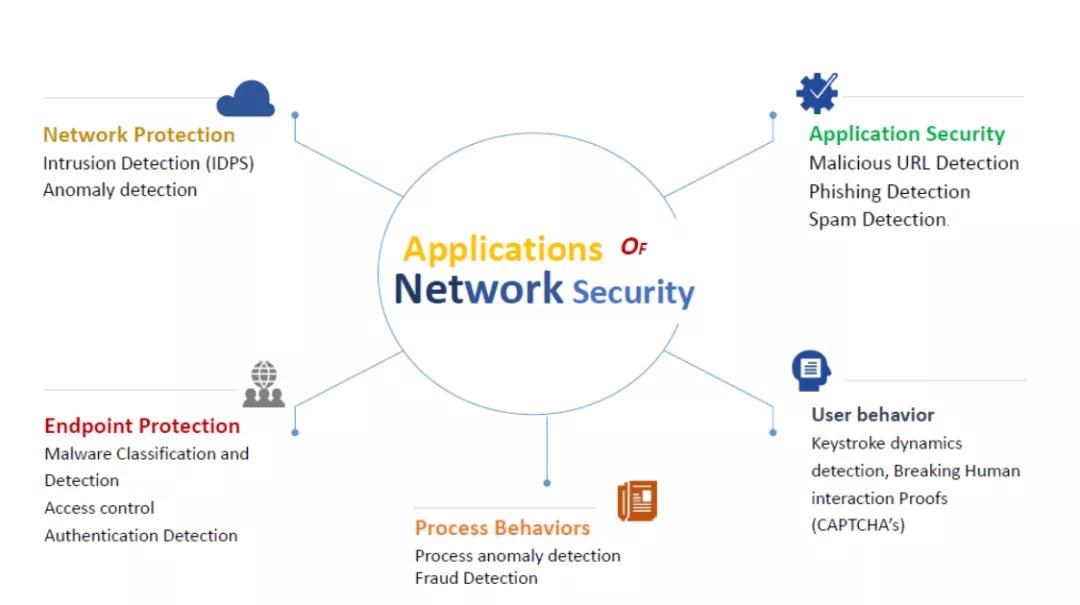

机器学习被普遍地用以实行网络安全层面的每日任务[6],包含互联网内部结构和互联网边沿的层层防御力。文章内容从互联网、终端设备、应用软件、过程个人行为和客户个人行为这五个领域对机器学习的使用进行论述(如下图二)。

图二 机器学习在网络安全中的运用[1]

3、对于机器学习的对抗攻击方式

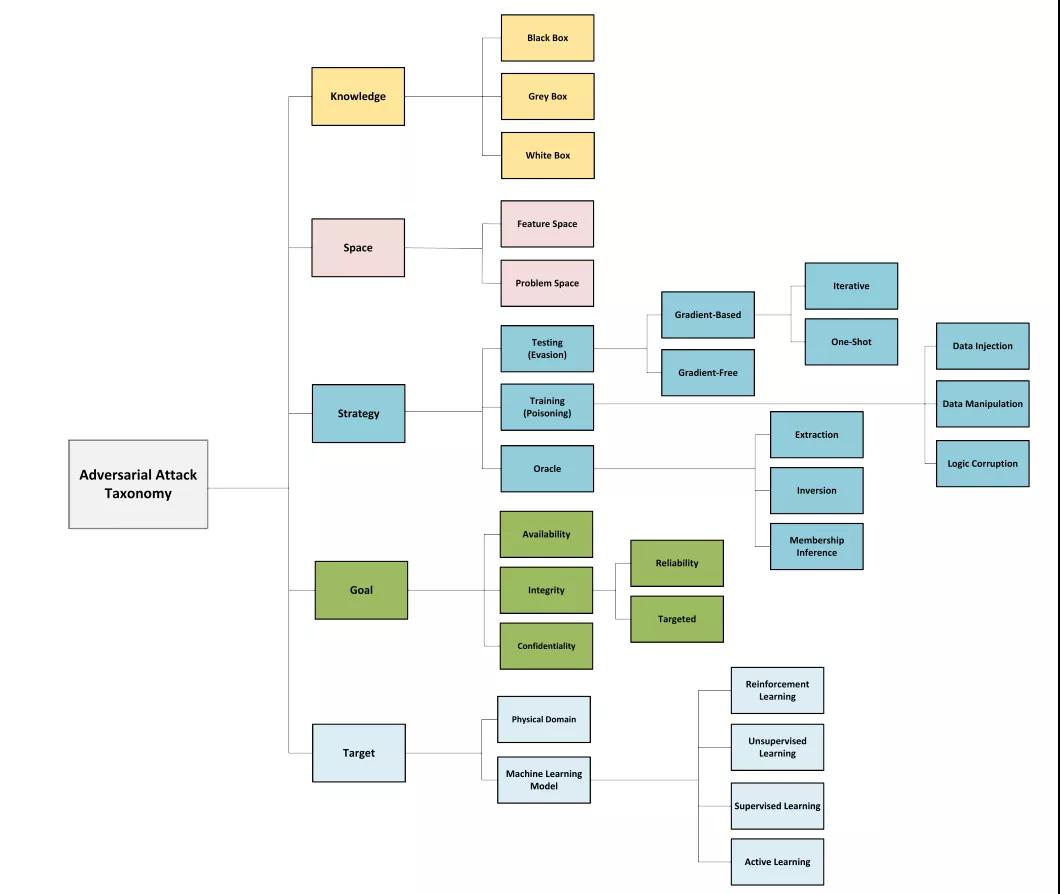

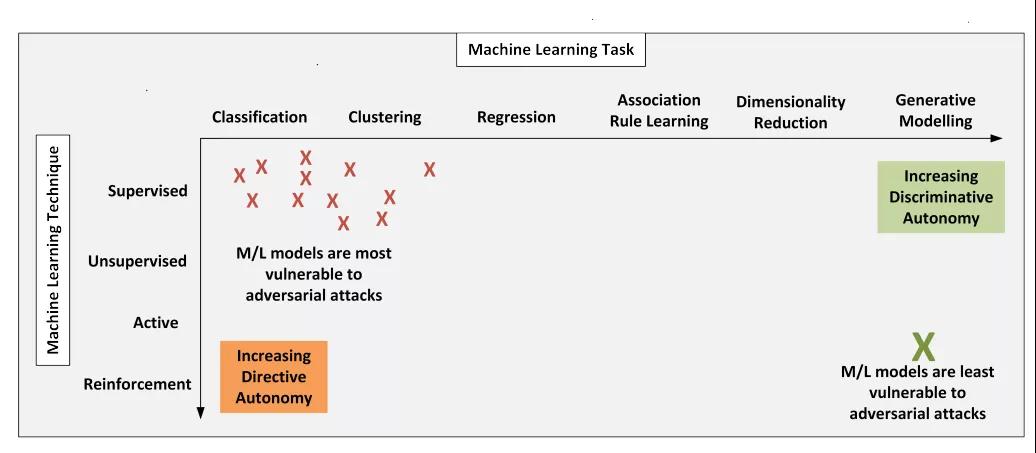

在对抗式机器学习中,攻击者尝试搞混机器学习实体模型使其作出失误的管理决策,通常的办法是在培训环节[7]或逻辑推理环节[8]改动键入到机器学习实体模型的导入数据信息。文章内容最先详细介绍了网络安全中对抗性攻击的危害实体模型,包含已经有专业知识、攻击室内空间、对策、总体目标和目标,接着详细介绍了各种各样对抗性攻击优化算法的分类方式(如下图三)。

图三 对抗性攻击的危害实体模型分类[1]

4、网络安全中的对抗攻击分类

前边那章是对机器学习和对抗技术性的分类,那麼此章便是对全部攻击个人行为的分类,其规范是特点范畴,即攻击者在控制或影响什么特点,以转化成对抗性样版。对于恶意程序检验、钓鱼攻击检验和垃圾短信检验应用软件的对抗性攻击尝试影响合理负荷作用,如二进制文件、URL或电子邮件。这种攻击被分类为对于节点维护体系的对抗性攻击。此外,也有对于互联网异常检测应用软件的对抗性攻击,这种类别的攻击将尝试影响协议书作用,如互联网数据库或协议书头。这种攻击被分类为对于互联网维护体系的对抗性攻击(如下图四)。

图四 对抗攻击分类[1]

5、对抗攻击风险评价

文章内容详细介绍了攻击风险评价的标准与架构:可热敏性的定义、根据模糊性定义的对抗性风险性架构[9]及其对抗性风险性网格图映射的概念。可热敏性指的是,为特殊深度神经网络模型设计的对抗性样版可以合理地造成不一样模式中的不正确分类,这被称作交叉式实体模型对抗性样版。对抗性风险性网格图投射的总体目标是评定对于机器学习实体模型的对抗性攻击取得成功的概率,及其该攻击取得成功后的不良影响(如下图五)。

图五 对抗性风险性网格图投射[1]

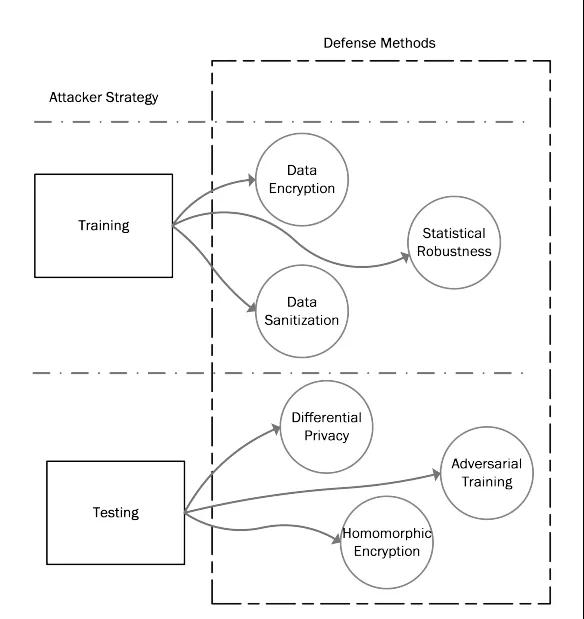

6、对抗攻击的防御力方式

文章内容详细介绍了现阶段采用的最多见的攻击方式,并按照对策和方式对它进行分类,包含梯度方向隐藏、防御力水蒸气蒸馏、对抗练习、对抗性样版检验、特点减缩和集成化防御力。这里与原文的攻击方式一部分展现一定水平的对应关系(如下图六)。

图六 根据攻击者对策的对抗性防御力方式[1]

三、汇总和未来展望

机器学习实体模型在网络安全中的对抗性系统漏洞风险性持续提升,鉴别主体性和命令主体性减少。殊不知,由文中引进的根据对抗性风险性网格图可以解析得到,仅有鉴别主体性和命令主体性的提高,对抗性易损性的隐患才会减少。在恶意程序分类行业留意到较大的对抗攻击效用是对抗性样版将根据深度神经网络的恶意程序分类器的成功率从97%减少到5%,这也是必须引起重视的。

与此相关也有许多可以科学研究的方位。攻击视角看来,在现有的对抗性样版的转化成方式中,很多特点遭受影响,实际上这只不过是一个最优解,现阶段依然缺少对对抗性样版转化成时必须振荡的最佳特点的科学研究;从防御力视角看来,现阶段大部分防御措施全是对于机器视觉中机器学习应用软件的攻击而制定的,而且分析的防御力通常是对于特殊攻击或攻击的一部分而制定的。

安全生产技术的选取和应用必须十分慎重。安全性在其他行业全是十分关键的,尤其是网络时代下的网络安全。因而,大家一直要想尽量地把前端高档的新技术应用在安全领域中,例如区块链技术、机器学习等。殊不知,这种“漂亮的补丁包”也有可能会变成攻击者的新通道。

论文参考文献

[1] bitoye O , Abou-Khamis R , Matrawy A , et al. The Threat of Adversarial Attacks on Machine Learning in Network Security -- A Survey[J]. 2019.

[2] Sahin Y , Duman E . Detecting Credit Card Fraud by Decision Trees and Support Vector Machines[J]. lecture notes in engineering & computer science, 2011.

[3] Lee K , Caverlee J , Webb S . Uncovering social spammers: social honeypots machine learning[C]// International Acm Sigir Conference on Research & Development in Information Retrieval. ACM, 2010.

[4] Kravchik M , Shabtai A . Anomaly detection; Industrial control systems; convolutional neural networks[J]. 2018.

[5] Zamani M , Movahedi M . Machine Learning Techniques for Intrusion Detection[J]. 2013.

[6] Deepak B N , Pavithra H . Applications of Machine Learning in Cyber Security. 2018.

[7] [1]Muoz-González, Luis, Biggio B , Demontis A , et al. Towards Poisoning of Deep Learning Algorithms with Back-gradient Optimization[C]// the 10th ACM Workshop. ACM, 2017.

[8] Biggio B , Corona I , Maiorca D , et al. Evasion Attacks against Machine Learning at Test Time[J]. 2017.

[9] Liao F , Ming L , Dong Y , et al. Defense against Adversarial Attacks Using High-Level Representation Guided Denoiser[J]. 2017.